Wir haben momentan (und perspektivisch ja eher noch schlimmer) ein Dilemma in der Personalbeschaffung:

Einerseits gibt es große Schwierigkeiten, Personal zu finden – Stichwort „Arbeitskräftemangel“ -, andererseits ist es essentiell (ebenfalls perspektivisch noch bedeutsamer werdend) möglichst „passend“ zu besetzen.

Ersteres kann wohl jeder bestätigen, der sich momentan mit Personalgewinnung beschäftigt.

Letzteres ist erstmal vielen nicht so klar, wird aber auf den zweiten Blick umso deutlicher: Weil die Anforderungen in den Jobs eher steigen und vor allem, weil man – aufgrund des Arbeitskräftemangels – eben nicht einfach „den nächsten Kandidaten aus der Schlange“ nehmen kann, wenn der erste ein Fehlgriff war, ist es so entscheidend – noch entscheidender als es das eh schon immer war -, dass die Auswahl gut gelingt. Man könnte auch sagen: Wer bei der Auswahl nicht sorgfältig agiert, der hat nicht nur weniger leistungsstarke Mitarbeitende, sondern der muss auch schneller wieder nachbesetzen, weil die nicht passenden Mitarbeitenden eben auch deutlich schneller wieder gehen.

Das Dilemma: Man hat also einerseits weniger Auswahl, muss aber andererseits eigentlich noch gründlicher hinschauen bei der Besetzung.

Das führt erstens dazu, dass die Bedeutung der Selbstauswahl und Orientierung steigt, d.h. je besser Menschen selber befähigt werden zu erkennen, welcher Beruf, welche Stelle bei welchem Unternehmen zu ihnen passt, desto mehr passende werden sich auch darauf bewerben bzw. desto weniger unpassende.

Und das führt zweitens dazu, dass wir diagnostische Instrumente im Recruiting brauchen (um Passung auch einschätzen zu können), die aber möglichst hoch akzeptiert sind (damit wir dadurch keine passenden KandidatInnen verlieren oder abschrecken).

Genau dieses Dilemma aufzulösen ist übrigens der Hintergedanke hinter dem Thema Recrutainment. So zeigt sich bspw., dass ein maßgeblicher Faktor für eine hohe Bewerberakzeptanz der Berufsbezug der eingesetzten Auswahlinstrumente ist.

Recrutainment und Akzeptanz: Welchen Beitrag können berufsbezogene Testverfahren leisten?

Aber da möchte ich heute gar nicht drauf hinaus (bzw. das kann demnächst detailliert in dem neuen Buch dazu gelesen werden…).

Heute geht es um einen anderen Aspekt, der ebenfalls genau an der Schnittmenge der Themen „valide und aussagekräftige Bewertung“ einerseits und „Nutzerakzeptanz“ andererseits verortet ist. Die Fragen:

Wie lang darf ein eigentlich Test sein? Stimmt es überhaupt, dass die Abbruchneigung steigt, je länger das Assessment ist?

Gemeinhin würde man hierbei wahrscheinlich annehmen, dass der Abbruch eines Tests bzw. dessen Ablehnung durch Bewerbende mit der Nutzungsdauer ansteigt, also je länger der Test, desto größer der Abbruch. In diesem Fall würde man also eine Erhöhung der Testgüte „erkaufen“ durch eine geringere Akzeptanz.

Aber stimmt das überhaupt?

Wir haben zu dieser Frage natürlich ein Menge Empirie, weil wir pro Jahr ja eine siebenstellige Anzahl an Tests durchführen. So zeigt sich bspw. für „typische Online-Assessments“ (also Testzusammenstellungen, die meist eine Gesamt-Netto-Nutzungsdauer von 45 bis 60 Minuten haben), dass diejenigen, die ein solches Assessment anfangen, dieses auch in den allermeisten Fällen vollständig bis zum Ende durchlaufen (die „Durchspielquote“ bei Online-Assessments dieser Art liegt im Schnitt bei knapp 97%).

Es gibt natürlich Bewerbende, die einer solchen Einladung gar nicht folgen – hier schwanken die Zahlen von Unternehmen zu Unternehmen, Branche zu Branche und Zielgruppe zu Zielgruppe recht stark zwischen 5% und 35%, immer auch stark davon abhängig, wie der Test anmoderiert und an wie vorselektiert dazu eingeladen wird – aber für diese No-Shows ist es im Prinzip ja egal, wie lang das Assessment gewesen wäre. Man könnte es etwas flapsig sagen: Für diese waren ja auch 0 Minuten schon zu lang…

Und bei den wenigen, die das Online-Assessment zwar beginnen, es aber nicht beenden, erfolgt der Abbruch quasi immer gleich ganz zu Beginn. Auch hier ist es mithin so, dass es diesen Personen im Prinzip egal ist, ob die Strecke vor ihnen noch 5 oder 50 Minuten lang gewesen wäre, denn sie sind ja bereits ausgestiegen.

Aber es gibt zu dieser Fragestellung natürlich auch akademische Forschung.

Und da möchte ich euch einmal in aller Kürze die Befunde einer Studie von Jay Hardy (Oregon State University) und KollegInnen vorstellen. Die Analyse „Are Applicants More Likely to Quit Longer Assessments? Examining the Effect of Assessment Length on Applicant Attrition Behavior“ (erschienen 2017 im Journal of Applied Psychology) beruht hierbei immerhin auf der stolzen Datenmenge von knapp 223.000 Jobsuchenden und deren Verhalten in 69 verschiedenen Auswahlsystemen.

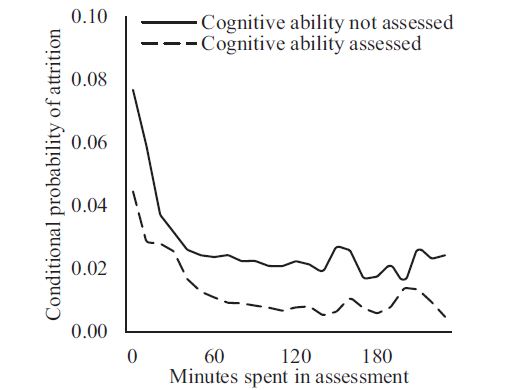

Es zeigt sich, dass die Neigung einen Test abzubrechen, zunächst einmal mit dessen Länge ABnimmt, nicht steigt. Das gilt, wenngleich auf etwas unterschiedlichem Niveau, für Tests, die kognitive Leistungsfähigkeit messen genauso für solche, die andere Merkmale überprüfen. Interessanterweise liegt die Neigung bei kogn. Leistungstests sogar niedriger als bei Tests anderer Merkmale. Erst wenn Tests dann wirklich sehr lang werden, scheint die Abbruchwahrscheinlich wieder anzusteigen. Da typische Online-Assessments meist mit einer Netto-Nutzungsdauer von +/-60 Minuten daherkommen, spielen diese Zeitbereiche aber wahrscheinlich eh keine große Rolle.

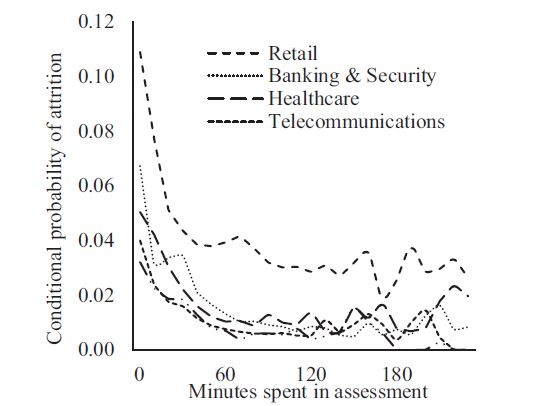

Und diesen Kurvenverlauf sieht man im Prinzip in allen Branchen, auch wenn die absolute Höhe der Kurven sich hier und da unterscheidet.

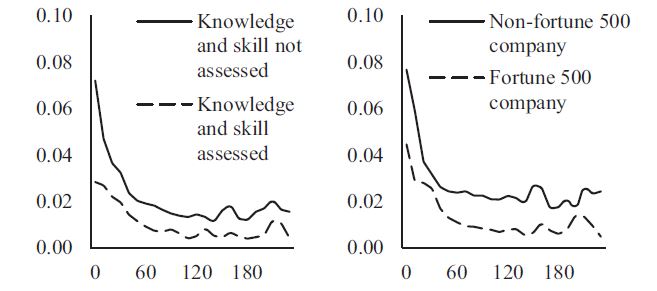

Es ist auch egal, ob dabei Wissen und Skills überprüft werden oder wie groß das jeweilige Unternehmen ist.

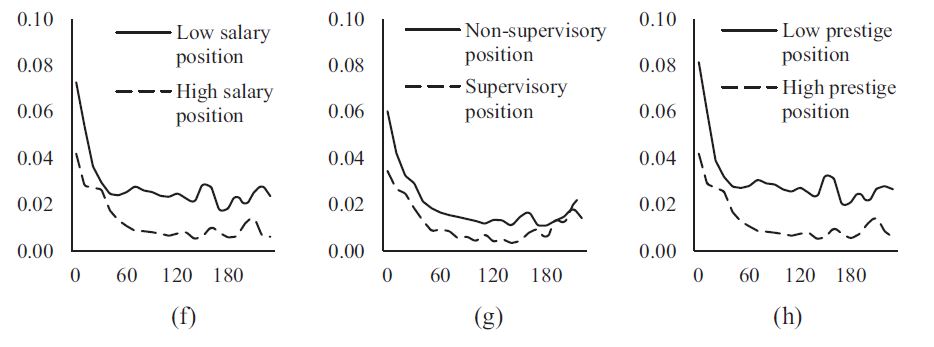

Und auch das Gehalt, Joblevel oder Prestige der Stelle ändern an der grundsätzlichen Aussage nichts.

Dieses Verhalten dürfte zum einen sicherlich mit sog. Sunk Cost Fallacy zu tun haben, d.h. der Neigung, Dinge, in die man bereits Zeit und Aufwand investiert hat, auch fortzusetzen. Und wenn z.B. am Ende eines Tests eine Belohnung etwa in Form eines Feedbacks wartet, dann handelt es sich ja noch nicht einmal um Sunk Cost.

Zum anderen jedoch dürfte hinter dem Verhalten auch die Erkenntnis vieler Nutzer liegen, dass eine valide und faire Auswahlentscheidung seitens des Unternehmens eben nicht durch einen „schnellen Blick in die Augen“ gelingen kann. Und an einer fairen und begründeten Auswahlentscheidung haben Bewerbende ein sehr starkes Interesse.

Die Studie kommt daher zu einem sehr bemerkenswerten Fazit:

Collectively, these findings suggest that efforts to curtail applicant attrition by shortening assessment length may be misguided.

Ich würde dies auch zu folgendem Appell an die Unternehmen umdichten:

Traut Euren Bewerbenden durchaus ein bisschen was zu! Die Vorstellung, dass diese es nur noch maximal einfach haben wollen, ist falsch. Sie wollen es so einfach wie möglich, richtig. D.h. unsinnige Hürden sind, ja. unsinnig und überflüssig. Bewerbende, die bereits ihren Lebenslauf hochgeladen haben, zu zwingen die exakt gleichen Inhalte nochmal in die Eingabefelder des Bewerbermanagementsystems einzugeben (jaaa, das gibt es in der Praxis noch immer zuhauf!), wäre ein Beispiel. Hier gilt es zu kürzen. Aber sinnvolle Hürden, nämlich solche, die helfen Eignung und Passung vorherzusagen, sind nicht nur aus Unternehmenssicht sinnvoll, sondern auch aus Sicht der Bewerbenden. Kein Bewerber, keine Bewerberin findet es gut, wenn er/sie das Gefühl hat, dass der Job nach Zufall oder auf´s Geratewohl vergeben wird. Warum? Weil es schlicht das genaue Gegenteil von fair ist.

Bewerbende akzeptieren sinnvolle Auswahlmethoden nicht nur, nein sie begrüßen sie.